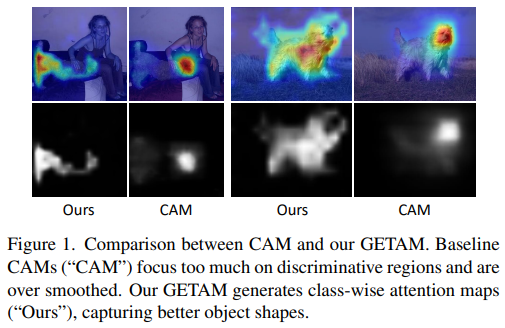

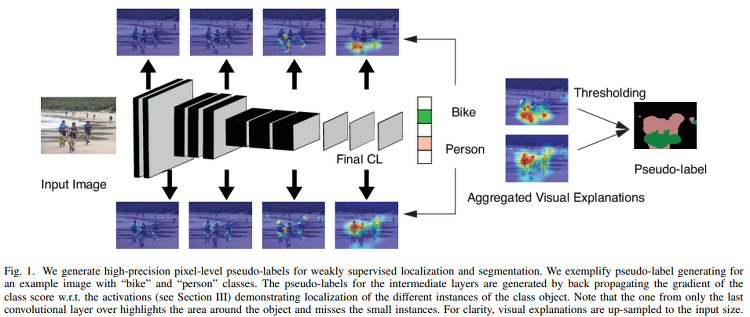

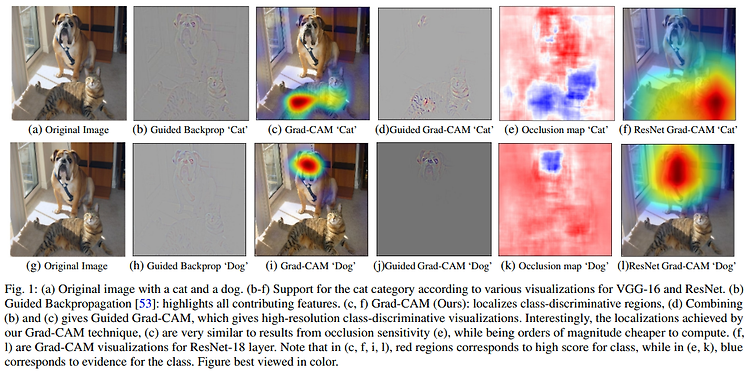

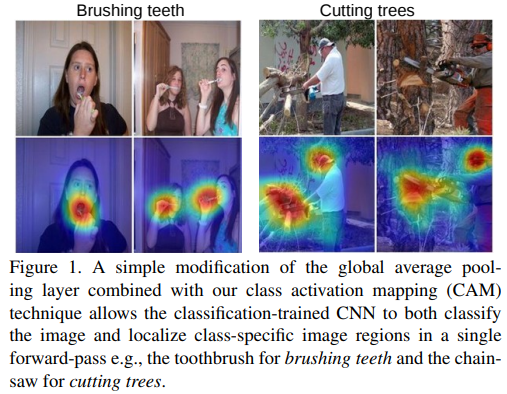

GETAM, Gradient-weighted Element-wise Transformer Attention Map for Weakly supervised Semantic Segmentation https://arxiv.org/abs/2112.02841 GETAM: Gradient-weighted Element-wise Transformer Attention Map for Weakly-supervised Semantic segmentation Weakly Supervised Semantic Segmentation (WSSS) is challenging, particularly when image-level labels are used to supervise pixel level prediction. To ..