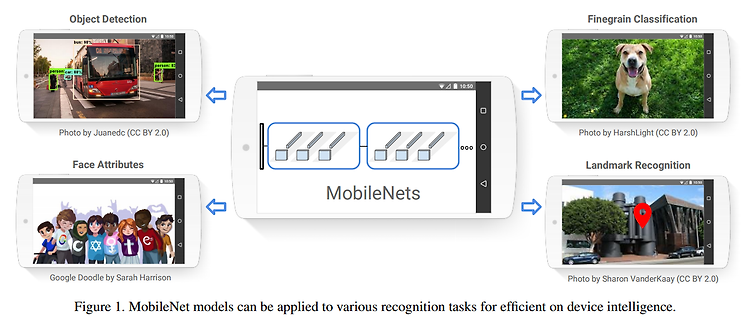

안녕하세요! 이번에 소개할 논문은 Residual Attention Network 입니다. Residual Attention Network는 자연어 처리에서 활발하게 이용하고 있는 Attention에서 영감을 받아 탄생한 모델입니다. 실제 Attention 알고리즘을 사용하지는 않고, 비슷한 개념을 이용하기 때문에 Attention 이름이 붙여졌습니다. Residual Attention Network는 Attention module로 이루어져 있습니다. 그리고, 이 Attention module은 다른 모델과 결합하여 사용할 수 있습니다. Attention module 내부에는 두 파트로 이루어져 있습니다. 마스크를 생성하는 부분과 기존 모듈(residual 모듈, inception 모듈)이 있습니다. ..