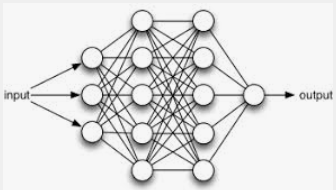

(밑바닥부터 시작하는 딥러닝, 사이토고키)를 바탕으로 제작하였습니다. 오차역전파법(4) - 오차역전파법을 사용한 학습 구현 이전의 포스팅에서는 역전파를 적용한 활성화함수(ReLu, Sigmoid) 계층, Affine 계층, Softmax-with-Loss 계층을 구현해 보았습니다. 이번 포스팅에서는 지금까지 구현한 계층을 조합해서 오차역전파법을 사용한 학습을 구현해보겠습니다. 7. 오차역전파법 구현하기 7.1 신경망 학습의 전체 그림 우선 신경망 학습의 전체 그림을 복습해보겠습니다. 다음은 신경망 학습의 순서입니다. 전체 신경망에는 적응 가능한 가중치와 편향이 있고, 이 가중치와 편향을 훈련 데이터에 적응하도록 조정하는 과정을 '학습'이라 합니다. 신경망 학습은 다음과 같이 4단계로 수행합니다. 1단계 ..