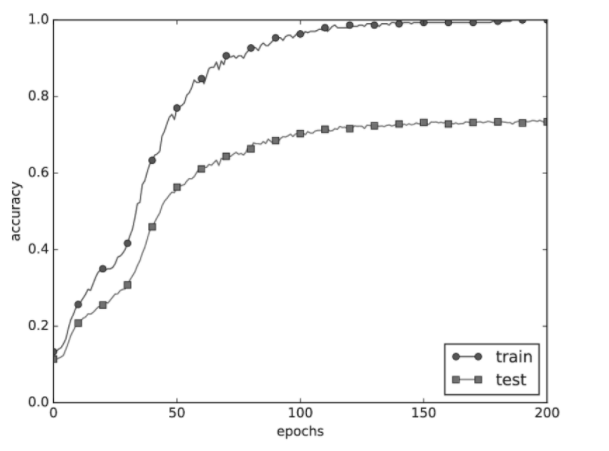

사이토고키의 을 공부하고 정리해보았습니다. [딥러닝] 오버피팅(과적합)이란? 사이토고키의 을 공부하고 정리해보았습니다. 오버피팅(과적합) 기계학습에서는 오버피팅이 문제가 되는 일이 많습니다. 오버피팅이란 신경망이 훈련 데이터�� deep-learning-study.tistory.com 이전 포스팅에서 오버피팅에 대해 알아보았습니다. 이번에는 오버피팅을 억제하는 방법에 대해 알아보겠습니다. 오버피팅 억제법 1. 가중치 감소 - weight decay 오버피팅 억제용으로 예로부터 많이 이용해온 방법 중 가중치 감소라는 것이 있습니다. 이는 학습 과정에서 큰 가중치에 대해서는 그에 상응하는 큰 페널티를 부과하여 오버피팅을 억제하는 방법입니다. 원래 오버피팅은 가중치 매개변수의 값이 커서 발생하는 경우가 많기 ..