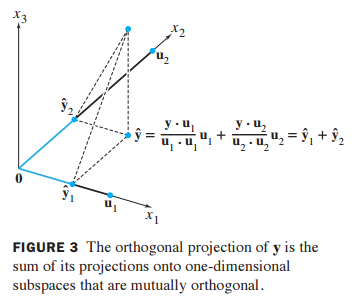

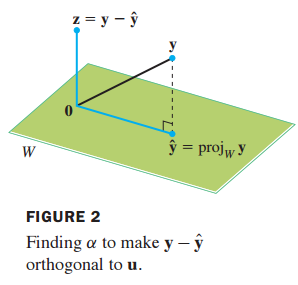

저번 포스팅에서 정사영이 무엇인지 간략하게 알아보았습니다. 이번에는 정사영에 대해 자세히 배워보도록 하겠습니다. 저번 시간에 배운 내용을 복습해보겠습니다. 벡터 y와 부분공간 W가 주어졌을 때, y를 서로 직교하는 두 개의 벡터 합으로 분해할 수 있다고 배웠습니다. 여기서 $\hat{y}$는 W 부분공간 안에 있으며 다음과 같이 구할 수 있습니다. 1. 이론 8 직교 분해 이론(The Orthogonal Decomposition Theorem) 벡터 y를 두 개의 벡터로 분해(decomposition)할 수 있으며 $\hat{y}$는 W 부분 공간안에 존재하고 z는 $W^{\perp}$에 존재합니다. 만약 {$u_1, ... ,u_p$}가 W의 직교 기저(orthogonal basis) 이면 $\hat{..